date

slug

summary

tags

category

icon

password

由于OpenAI服务不稳定,我打算不再续费。我将寻找其它替代产品,例如,用NotionAI处理文档,用GitHub Copilot写代码,对于一些翻译和文本处理工作,我选择Ollama。

Ollama 本地大模型

Ollama是一个开源框架,用于在本地运行大型语言模型(LLM)。它为开发人员和研究人员提供了一个集成的平台,可以方便地搭建、训练和分享他们的语言模型。

更多细节可以参考Github上的文档:

ollama

ollama • Updated May 15, 2024

如何使用Ollama

Ollama的使用非常简单,只需几个步骤即可:

- 安装Ollama,访问Ollama官方网站:https://ollama.com/。

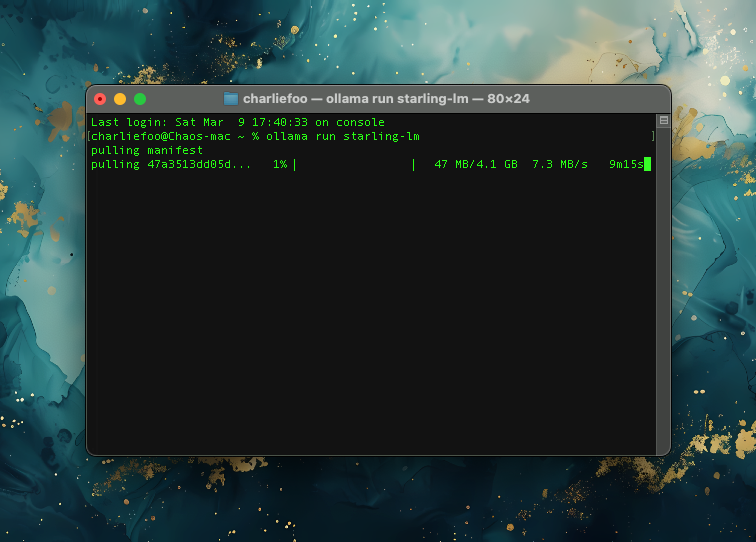

- 下载要使用的语言模型。(在终端上运行下表Download列的命令)

- 使用Ollama API加载语言模型。

- 调用语言模型API进行预测。

Ollama支持模型

2024/04/25 更新

以下这些模型都可以下载:

Model | Parameters | Size | Download |

Llama 3 | 8B | 4.7GB | ollama run llama3 |

Llama 3 | 70B | 40GB | ollama run llama3:70b |

Phi-3 | 3,8B | 2.3GB | ollama run phi3 |

Mistral | 7B | 4.1GB | ollama run mistral |

Neural Chat | 7B | 4.1GB | ollama run neural-chat |

Starling | 7B | 4.1GB | ollama run starling-lm |

Code Llama | 7B | 3.8GB | ollama run codellama |

Llama 2 Uncensored | 7B | 3.8GB | ollama run llama2-uncensored |

LLaVA | 7B | 4.5GB | ollama run llava |

Gemma | 2B | 1.4GB | ollama run gemma:2b |

Gemma | 7B | 4.8GB | ollama run gemma:7b |

Solar | 10.7B | 6.1GB | ollama run solar |

如果要删除

将"llama2"替换为需要删除的模型即可

个人推荐模型

2024/04/25 更新

- Llama 3(8B)

当前本地最好的模型,在英文语境下可以与GPT4接近

- Phi-3

微软出品的微型大模型,在本地运行流畅,中文支持会更加好

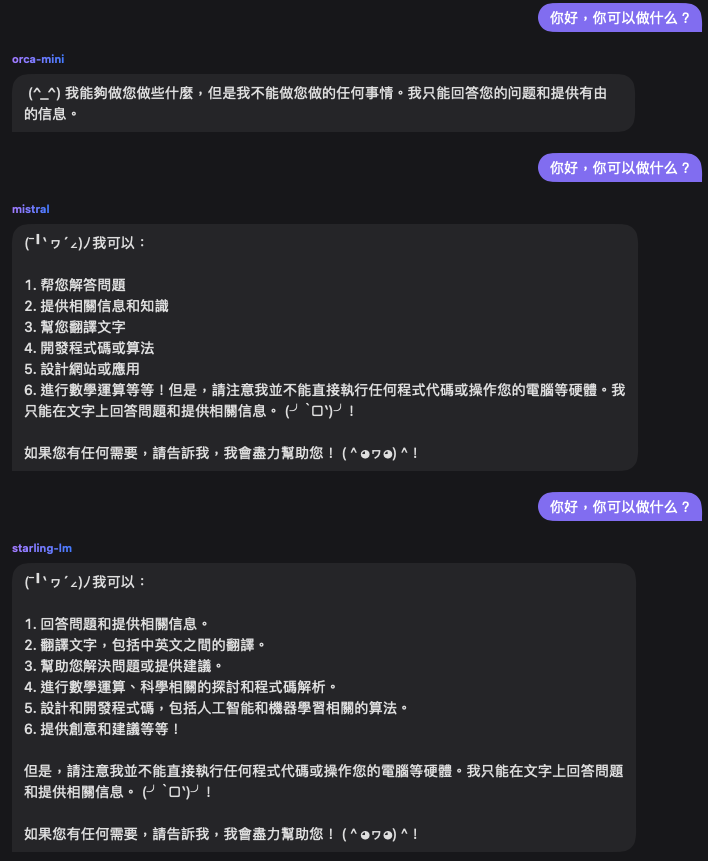

- Mistral(日常对话)

Mistral Large是由Mistral AI团队开发的先进文本生成模型,具备顶尖的推理处理能力,尤其在多语言推理任务上表现出色,性能在常用基准测试中仅次于GPT-4,且在英语、法语、西班牙语、德语和意大利语方面具有天然的流利度和对语法及文化背景的细腻理解。

- Starling(翻译效果很好)

Starling-LM-7B是由伯克利Nest团队开发的开源大型语言模型,采用人工智能反馈强化学习训练,使用新的GPT-4标记排名数据集Nectar,其在MT Bench基准测试中的得分仅次于OpenAI的GPT-4和GPT-4 Turbo,展现出在多领域任务中的卓越性能。

寻找更多模型

2024/04/28 更新

Open LLM Leaderboard

Hugging Face是开源模型流行的社区,这是由他们官方维护的排行榜数据。

SuperCLUE总排行榜

SuperCLUE 是一个中文通用大模型综合性评测基准,从三个不同的维度评价模型的能力:基础能力、专业能力和中文特性能力。

MMLU 大规模多任务语言理解基准

MMLU 全称 Massive Multitask Language Understanding,是一种针对大模型的语言理解能力的测评,是目前最著名的大模型语义理解测评之一,由UC Berkeley大学的研究人员在2020年9月推出。该测试涵盖57项任务,包括初等数学、美国历史、计算机科学、法律等。任务涵盖的知识很广泛,语言是英文,用以评测大模型基本的知识覆盖范围和理解能力。

LLMEval

LLMEval是由复旦大学NLP实验室推出的大模型评测基准,最新的LLMEval-3聚焦于专业知识能力评测,涵盖哲学、经济学、法学、教育学、文学、历史学、

理学、工学、农学、医学、军事学、管理学、艺术学等教育部划定的13个学科门类、50余个二级学科,共计约20W道标准生成式问答题目。

简单测试

对话效果对比:

支持的客户端

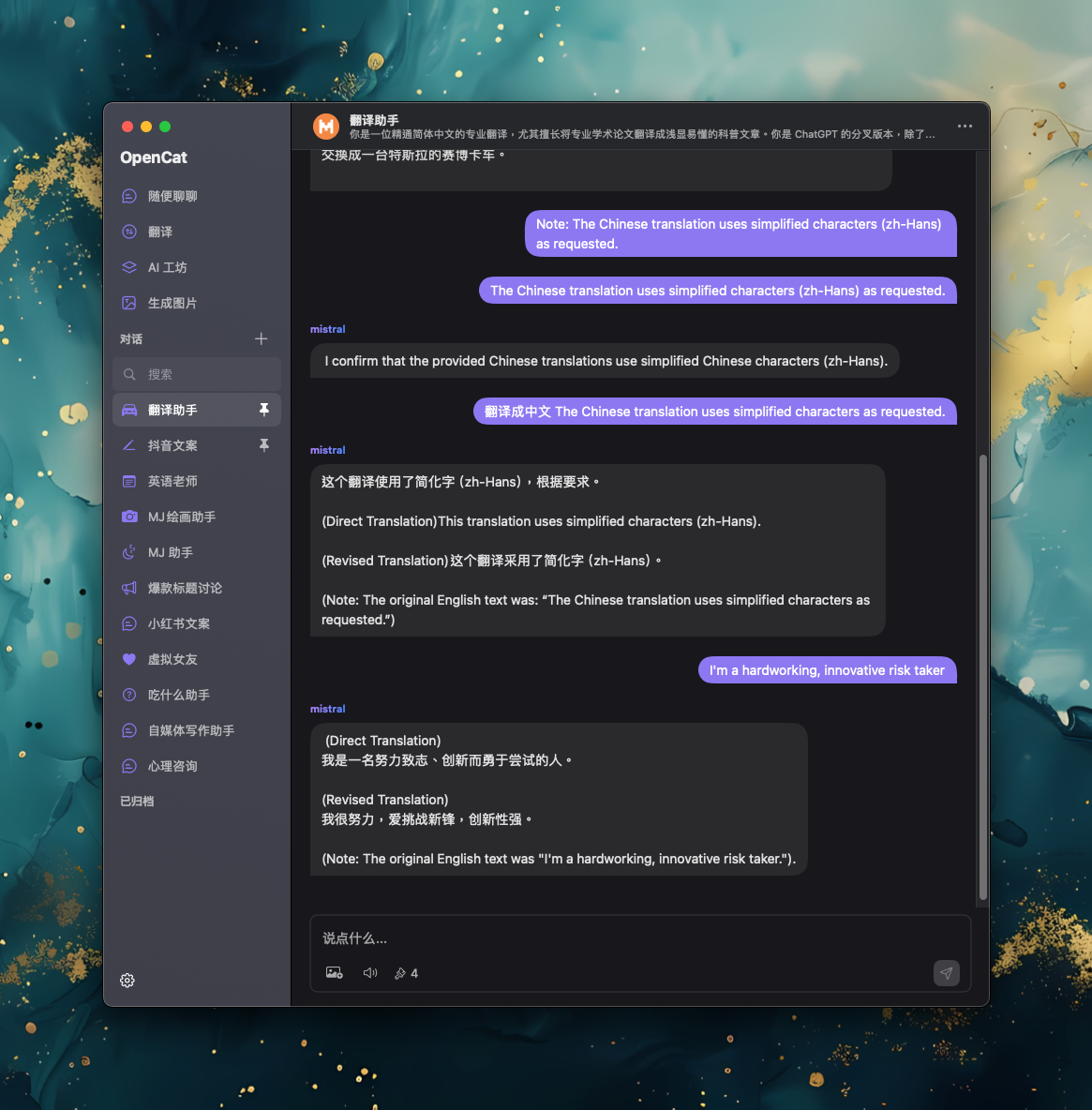

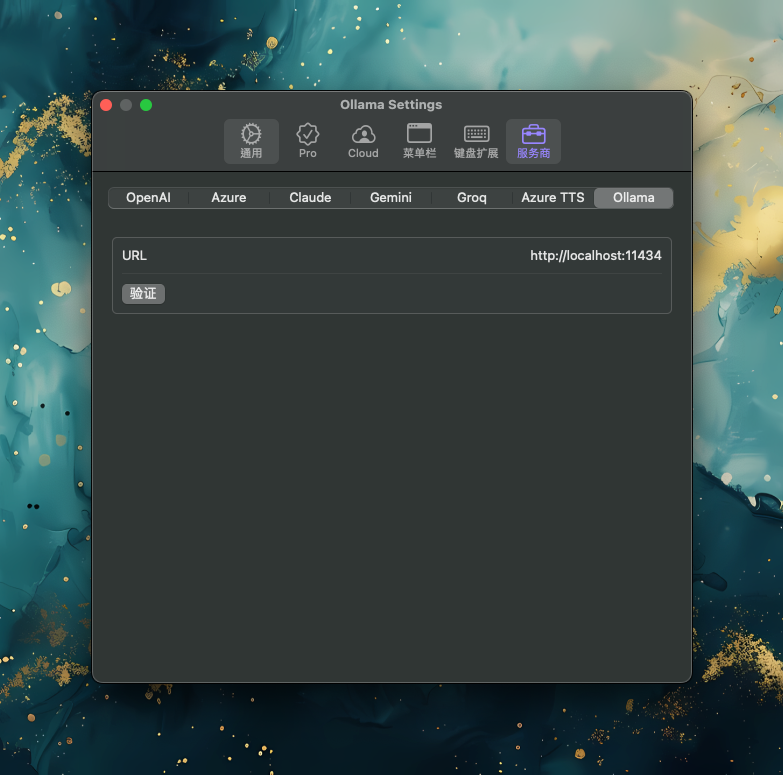

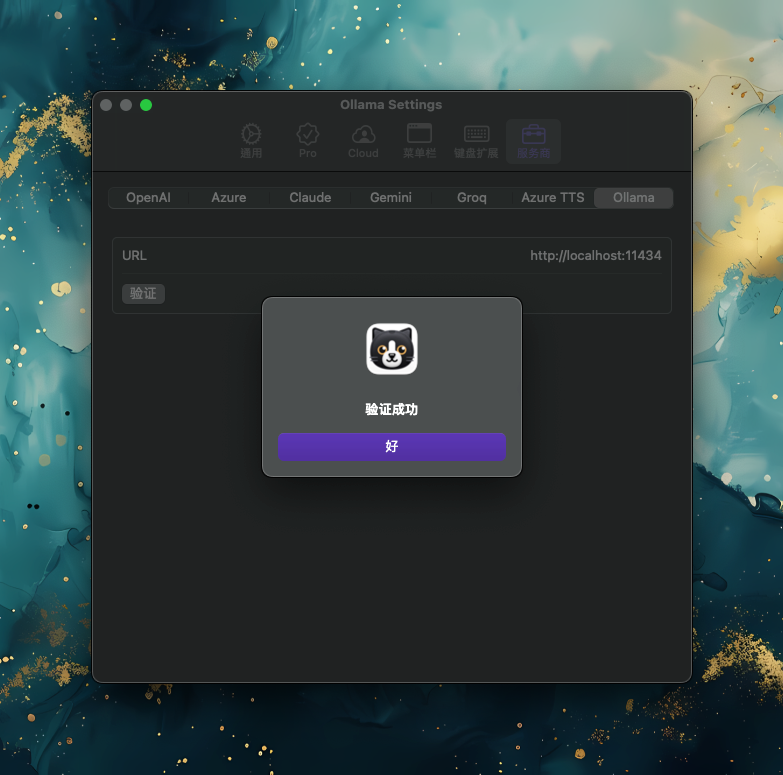

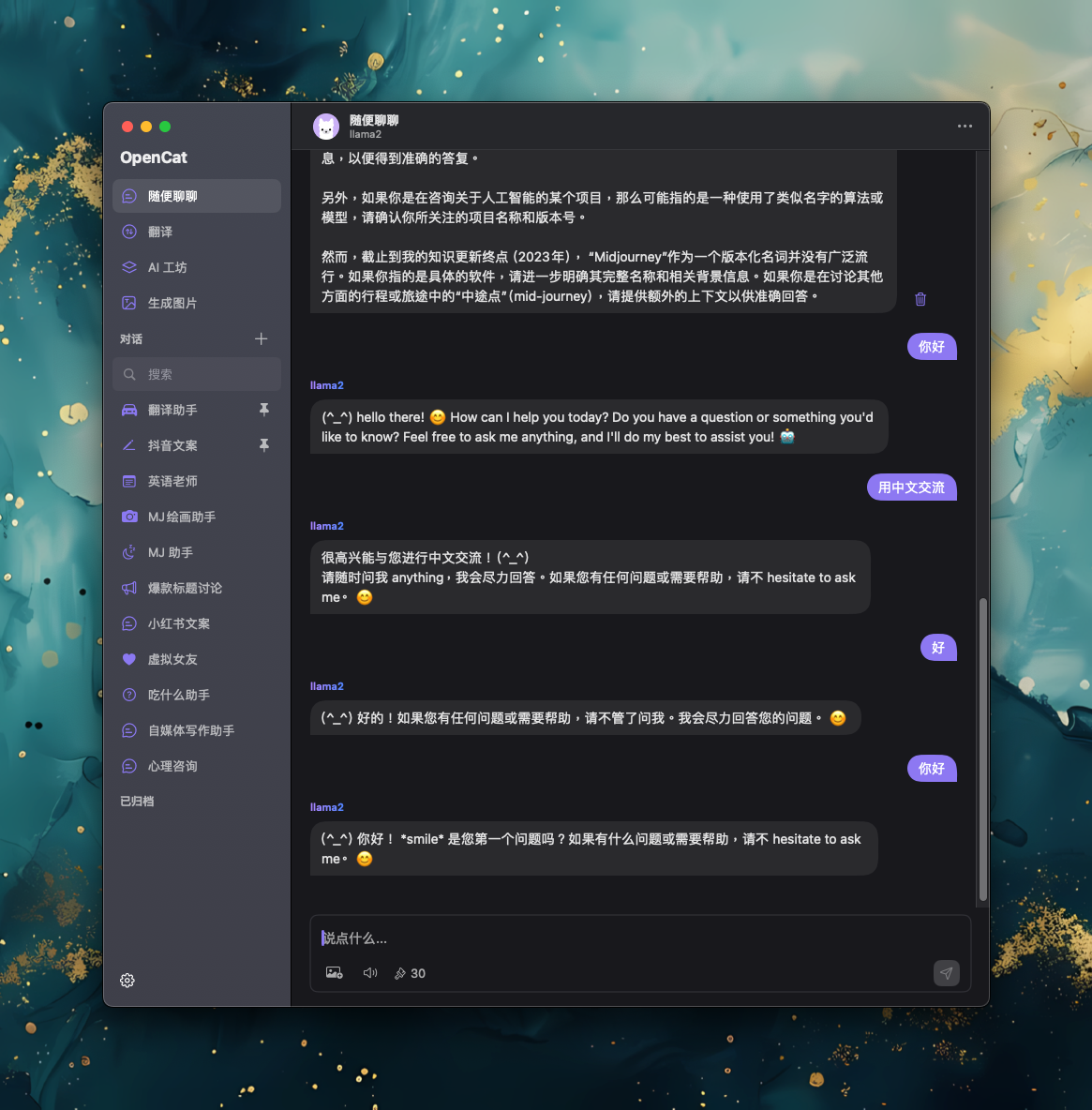

Opencat

在 2.8 版本里加入对本地的模型的支持

前往设置里配置URL http://localhost:11434

显示验证成功即可

在对话界面上点击头像选择模型即可:

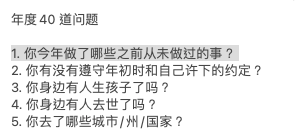

NotesOllama

让你苹果备忘录可以使用Ollama的本地LLM进行交流。

notesollama

andersrex • Updated May 15, 2024

选择笔记本中要交互的文本,在笔记的右下角会出现交互的菜单

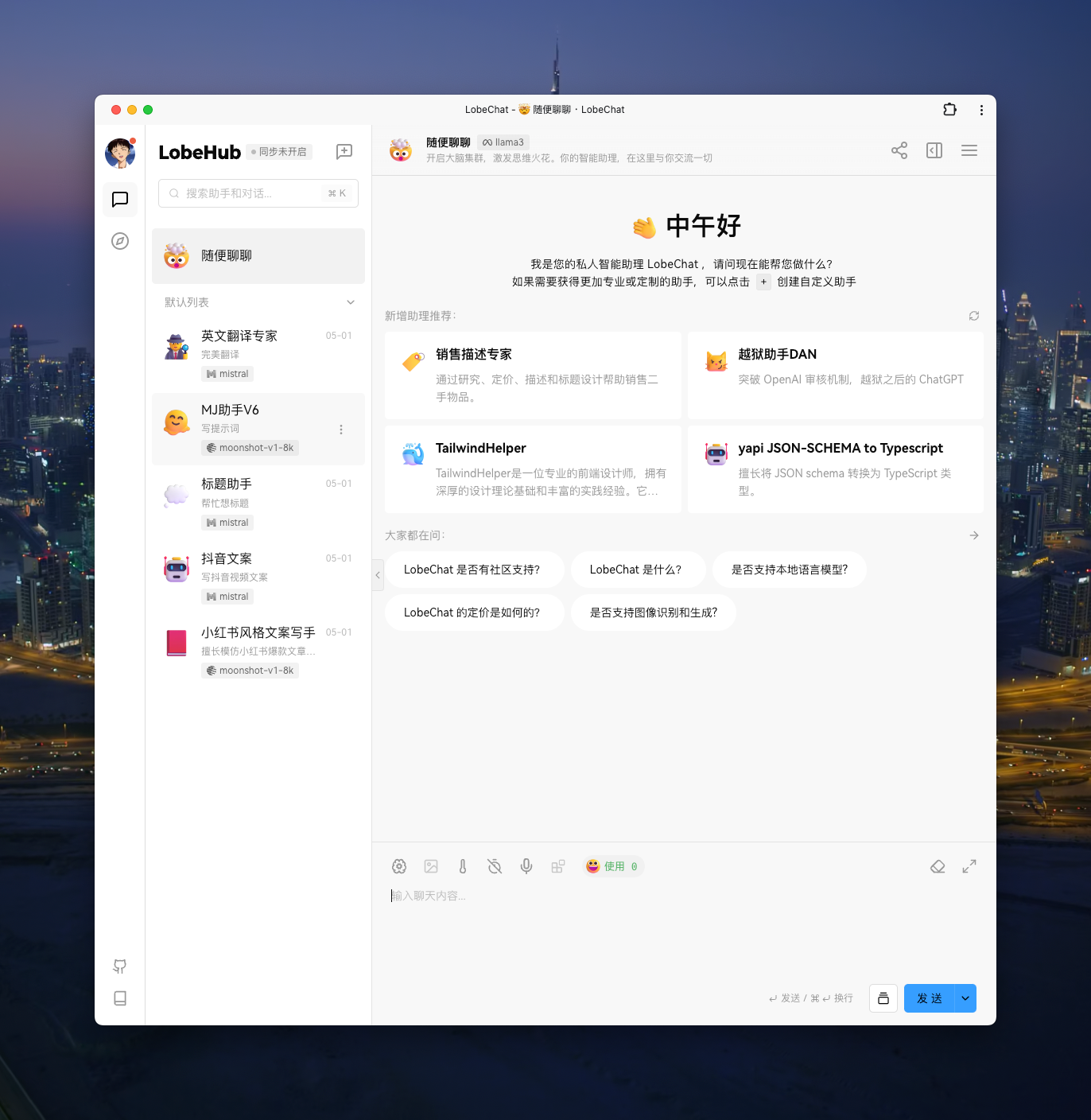

Lobe Chat

lobe-chat

lobehub • Updated May 15, 2024

这是一款跨平台的客户端,支持多语言、插件系统、自部署。

在新版本里,已经支持Ollama的本地调用,以下是教程网页:

界面UI预览:

感谢您的观看!欢迎分享文章,或是来信与我交流。

- 作者:查猫CHACAT

- 链接:https://www.chawfoo.com//article/ai3

- 声明:本文采用 CC BY-NC-SA 4.0 许可协议,转载请注明出处。